반응형

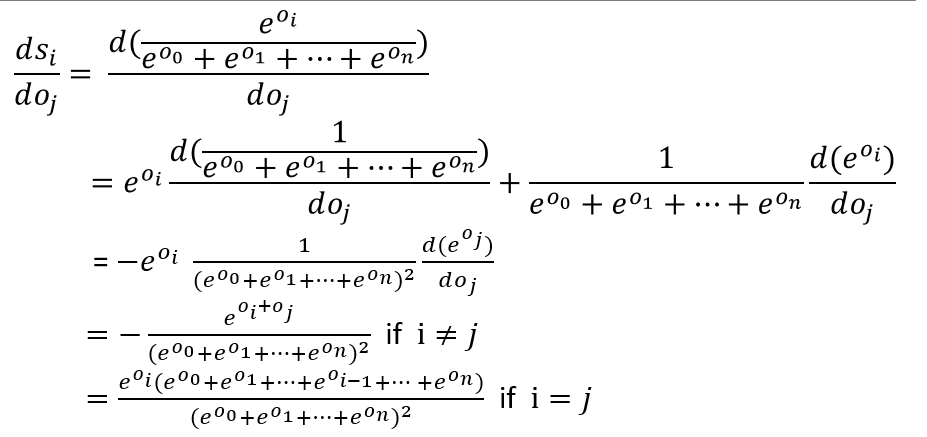

2. dsoft / do

이 경우를 2차원으로

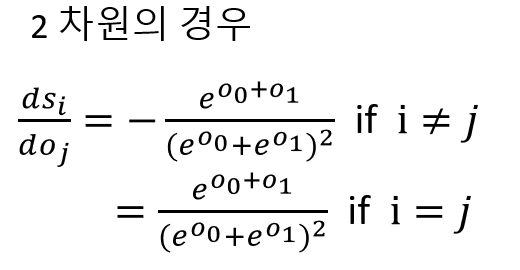

그림으로 표현하자면,

따라서 dl/dO0 는

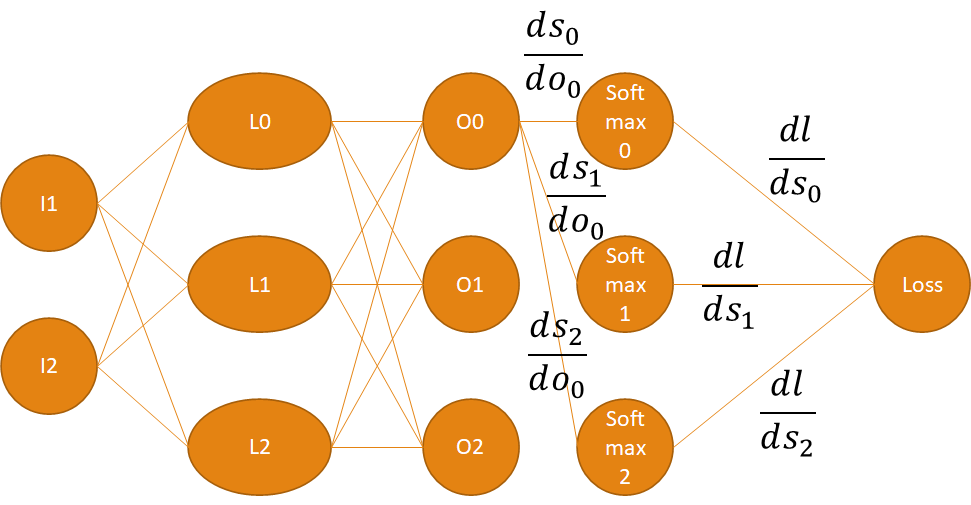

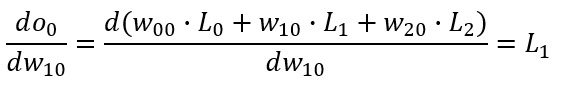

3. do/dw

- 두번째 w값에 대한 Loss의 변화량을 구하기 위함

앞서 Output Layer에서는 ReLU를 적용시키지 않는다 하였기 때문에,

따라서 위와 같은 구조의 NN 일 경우 9개의 미분값이 나온다,

처음부터 생각하자면,

와 같은 구조가 된다.

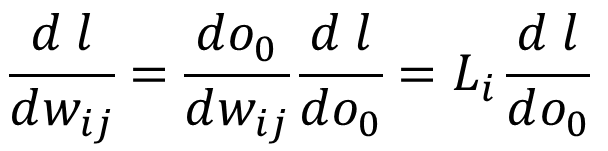

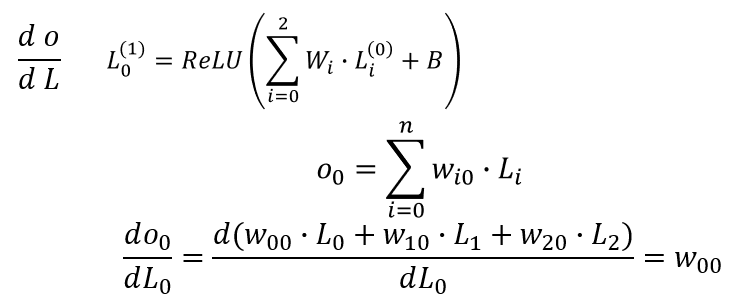

4. dl / dL (dLoss / d L)

- 하기에 앞서 do/dL을 구해야 한다.

이것을 일반화하면,

이어서 L의 변화량에 따른 loss의 변화량을 찾아야한다.

반응형

'머신러닝' 카테고리의 다른 글

| Feed - Foward 정리 (0) | 2021.06.18 |

|---|---|

| Back - Propagation 3 (0) | 2021.06.18 |

| Back - propagation 1 (0) | 2021.06.18 |

| 인공신경망의 학습 (0) | 2021.06.17 |

| 인공신경망의 기초 (0) | 2021.06.17 |

댓글